自回归因果注意力也能并行解码?上交联合UCSD突破LLM推理瓶颈,模型代码全开源

自回归因果注意力也能并行解码?上交联合UCSD突破LLM推理瓶颈,模型代码全开源在大语言模型(LLM)落地应用中,推理速度始终是制约效率的核心瓶颈。传统自回归(AR)解码虽能保证生成质量,却需逐 token 串行计算,速度极为缓慢;扩散型 LLM(dLLMs)虽支持并行解码,却面

来自主题: AI技术研报

8413 点击 2025-12-31 09:21

搜索

搜索

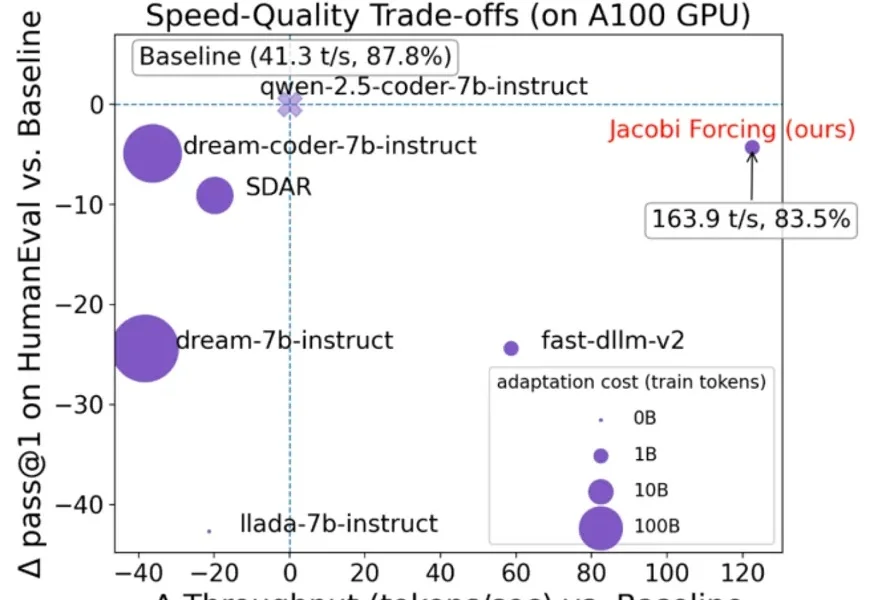

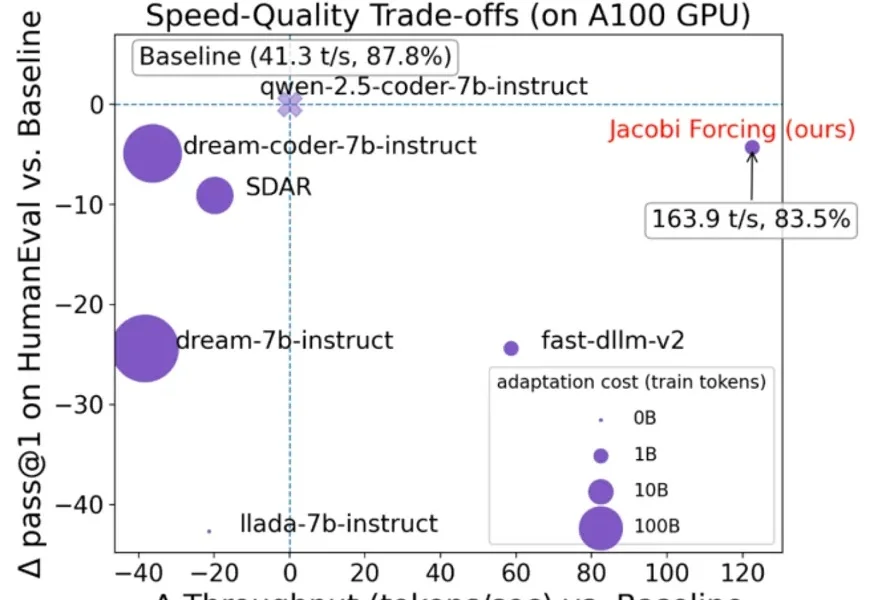

在大语言模型(LLM)落地应用中,推理速度始终是制约效率的核心瓶颈。传统自回归(AR)解码虽能保证生成质量,却需逐 token 串行计算,速度极为缓慢;扩散型 LLM(dLLMs)虽支持并行解码,却面